Ollama v0.19.0版本发布,重点优化了KV缓存命中率以提升响应速度并降低成本,新增Web搜索插件使AI能获取实时信息,修复了Qwen系列模型的工具调用解析等问题,同时改进了macOS的MLX Runner并修复多项错误,提升了整体稳定性和性能。

Ollama 发布了 v0.19.0 版本,主要聚焦于 KV 缓存命中率优化、工具调用解析修复,以及新增 Web 搜索插件。这个版本虽然没有大的功能新增,但在稳定性和性能方面有不少改进。

🔧 主要更新内容

KV 缓存命中率提升

使用 Anthropic 兼容 API 时,KV 缓存命中率得到了改进。这意味着在使用 Claude 等模型时,重复的上下文部分可以更好地被缓存,减少重复计算,提升响应速度并降低 API 调用成本。

Web 搜索插件上线

ollama launch pi 命令现在包含了 Web 搜索插件,使用 Ollama 自带的搜索功能。这让 AI 助手可以直接搜索互联网获取最新信息,不再受限于训练数据的截止日期。

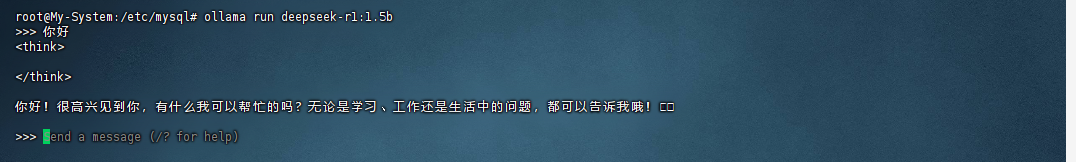

工具调用解析修复

修复了 Qwen3.5 模型的工具调用解析问题,之前工具调用内容会错误地输出在 thinking 模式中。同时修复了 qwen3-next:80b 模型无法加载的问题。

MLX Runner 改进(macOS)

- MLX Runner 现在会在 prompt 处理过程中创建定期快照

- 修复了 MLX Runner 中 KV 缓存快照的内存泄漏问题

其他修复

- Ollama 应用不再错误显示"模型已过时"的提示

- 修复了 grok 模型错误启用 Flash Attention 的问题

📦 升级方式

# 下载最新版本

curl -fsSL https://ollama.com/install.sh | sh

# 或者通过 Docker

docker pull ollama/ollama:latest💡 小提示:如果你主要使用 Qwen 系列模型,建议尽快升级以获得更好的工具调用体验。

暂无评论

要发表评论,您必须先 登录